▲

- A clonagem de inteligência artificial cresce no Brasil, mas não há regulamentação específica para essa prática.

- Você deve se proteger evitando compartilhar dados sensíveis e verificando a autenticidade de conteúdos para reduzir riscos com deepfakes.

- A falta de leis claras amplia riscos de fraudes, manipulação de dados e dificulta a punição de crimes relacionados à clonagem de IA.

- Essa situação impacta empresas, investidores, consumidores e o desenvolvimento de políticas públicas para uso ético da IA no país.

A clonagem de inteligência artificial (IA) cresce rapidamente no Brasil, mas a falta de uma regulamentação clara cria um cenário legal incerto. Com o avanço da tecnologia, surge um dilema sobre direitos, ética e segurança jurídica que pode transformar esse avanço em uma verdadeira bomba legal.

O que é clonagem de IA e por que preocupa?

A clonagem de IA refere-se à reprodução de modelos, vozes ou comportamentos de sistemas inteligentes artificiais sem a autorização do autor ou da empresa responsável. No Brasil, essa prática ainda não conta com regras específicas para seu uso ou penalização.

Essa ausência legal gera dúvidas quanto à proteção dos direitos autorais, ao uso indevido de dados pessoais e à responsabilidade em casos de danos causados por sistemas clonados. Cria um terreno fértil para fraudes, deepfakes e manipulações, impactando o setor de tecnologia e a sociedade.

O Brasil não está sozinho nessa situação. Muitos países enfrentam dificuldades para acompanhar a velocidade da inovação em IA. Porém, falta uma legislação ágil que equilibre a inovação e a proteção dos direitos individuais e comerciais.

Sem regras claras, investidores e empresas ficam expostos a riscos, enquanto os consumidores e cidadãos podem sofrer consequências de tecnologias pouco monitoradas.

Riscos jurídicos e exemplos recentes no Brasil

Um dos problemas que se destaca é a possibilidade de uso não autorizado da imagem e voz de pessoas, criando deepfakes com finalidades duvidosas, como fraudes financeiras e manipulação política.

As eleições brasileiras de 2026 já apontam desafios com fake news e desinformação geradas por IA, e a clonagem pode agravar ainda mais o quadro. A ausência de legislação específica dificulta a punição eficaz desses crimes.

Além disso, empresas que desenvolvem softwares de IA enfrentam dificuldades para proteger seus investimentos em modelos de aprendizado. O risco de clonagem reduz os incentivos para inovações locais e afeta o mercado nacional.

Por outro lado, a execução de penas ou responsabilização civil por danos gerados por IAs clonadas ainda carece de definições claras no ordenamento jurídico brasileiro, criando um vácuo perigoso para a segurança jurídica.

De que maneira o Brasil trata a IA atualmente?

Hoje, a legislação brasileira que pode tocar no tema é muito genérica e fragmentada, como a Lei Geral de Proteção de Dados (LGPD), que regula o uso de dados pessoais, mas não aborda diretamente a clonagem de IA. Outra lacuna está na falta de normas específicas sobre deepfakes e uso indevido de tecnologia.

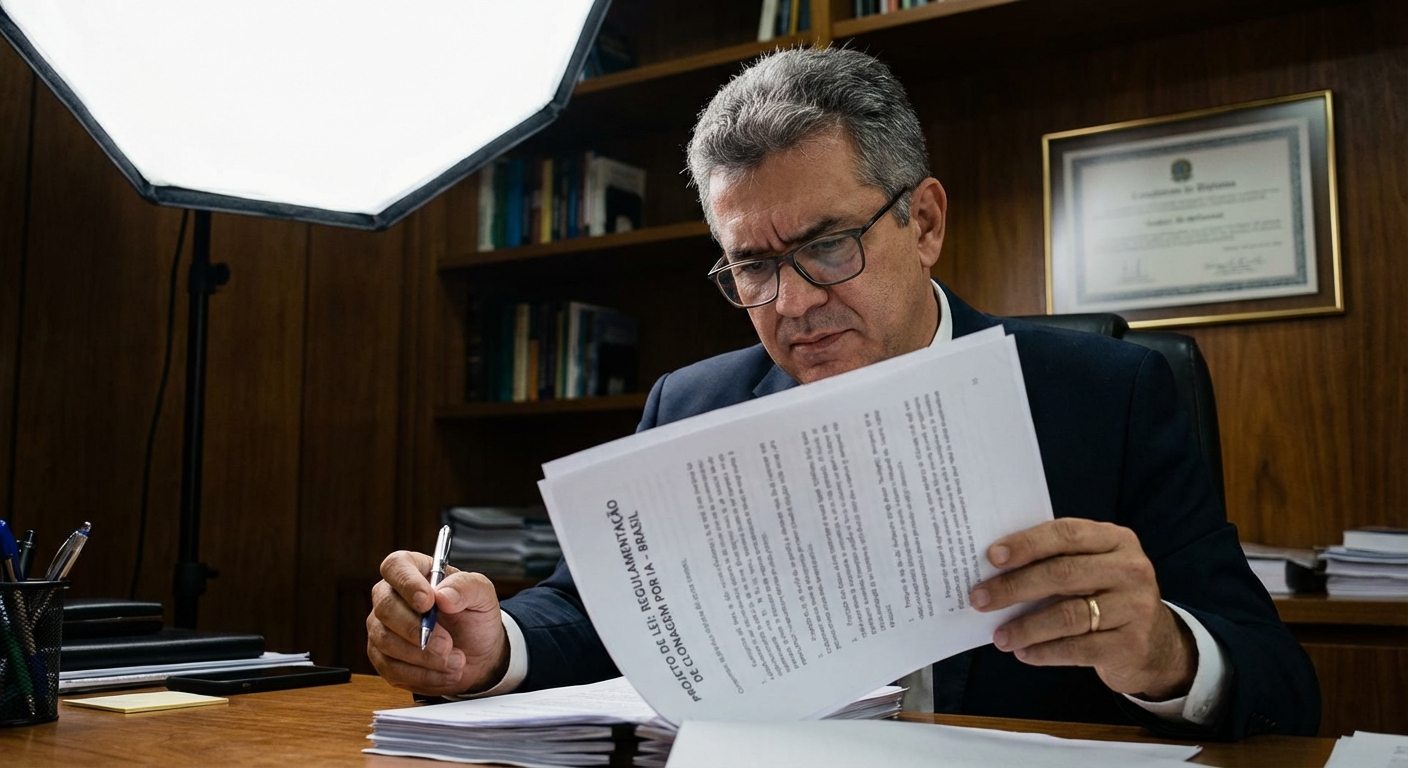

O Congresso Nacional tem discutido projetos relacionados à regulação da IA, mas nenhuma lei foi aprovada até o momento que trate da clonagem ou do uso responsável desses recursos.

Organizações governamentais e o setor privado têm alertado para a urgência dessa regulação, visando proteger tanto a inovação quanto os direitos dos usuários, mas o avanço ainda é lento.

Enquanto isso, especialistas indicam que a legislação internacional, como a Europeia, pode servir de base para o Brasil, adaptando as normas para o contexto nacional.

Possíveis impactos para a sociedade e o mercado

A falta de regras pode trazer complicações legais para empresas que investem pesado em IA, dificultando acordos comerciais e parcerias internacionais.

Para o cidadão comum, a clonagem de IA sem controle aumenta o risco de exposição a golpes sofisticados, roubo de identidade e ataques à privacidade, especialmente via deepfakes e assistentes virtuais maliciosos.

O crescimento de tecnologias clonadas pode também alterar a confiança no mercado digital e em processos automatizados, impactando setores como a segurança, saúde, e até o sistema judiciário.

Além disso, a ausência de regulamentação pode limitar o desenvolvimento de políticas públicas eficazes para a utilização ética da IA, afetando diretamente áreas sensíveis.

Como outras áreas da tecnologia enfrentam desafios legais no Brasil

O Brasil ainda enfrenta desafios em regulamentar tecnologias emergentes, como a segurança digital e o combate às fake news, que têm relação com a clonagem de IA.

Protocolos específicos para proteção de dados e cibersegurança, apesar de avanços, ainda mostram lacunas, expondo usuários a riscos crescentes. Grandes empresas multinacionais estão atentas a essas brechas regulatórias.

Emergências relacionadas à privacidade digital e manipulação de informações já são pauta permanente em discussões sobre o uso da IA em eleições e plataformas virtuais.

Estes temas estão conectados à discussão sobre a clonagem de IA, demonstrando a necessidade de um marco legal amplo e coerente no Brasil para lidar com essas tecnologias.

O que esperar da regulamentação da clonagem de IA no Brasil?

Apesar das incertezas, especialistas e autoridades indicam que o iminente avanço normativo será fundamental para dar segurança jurídica e ética ao uso de IA no país.

Projetos de lei em tramitação podem estabelecer direitos e deveres claros sobre clonagem, uso de dados, responsabilidade civil e penal, e a proteção de direitos individuais e coletivos.

A regulamentação deve equilibrar a inovação tecnológica e o respeito aos direitos humanos, incentivando investimentos responsáveis e protegendo o cidadão contra abusos.

Esse cenário exige um diálogo constante entre governo, setor privado, academia e sociedade civil para consensos efetivos e adaptações rápidas conforme o avanço da tecnologia.

O que os usuários podem fazer enquanto a lei não chega?

- Evitar compartilhar dados e conteúdos sensíveis em plataformas que utilizam IA sem transparência.

- Verificar a autenticidade de conteúdos enviados por redes sociais para reduzir o impacto de deepfakes.

- Buscar informações sobre os direitos digitais básicos e como identificar usos indevidos de tecnologias.

- Acompanhar notícias sobre debates legais e envolvimento da sociedade nas discussões.

- Utilizar ferramentas tecnológicas confiáveis e certificadas para maior segurança.

A responsabilidade também recai sobre empresas para a adoção de práticas éticas e segurança em seus sistemas, minimizando riscos.

Ao mesmo tempo, profissionais e gestores de tecnologia devem monitorar tendências globais e adaptar suas políticas internas para se antecipar a mudanças legais.

Enquanto não há legislação específica, o aperfeiçoamento da LGPD e discussões sobre ética em IA são os principais instrumentos disponíveis para tentar mitigar riscos.

Esse tema também dialoga com outros debates recentes no Brasil, como os desafios da cibersegurança e o uso da IA em áreas como o Judiciário, onde a ausência de regulamentação já gera riscos legais emergentes.

Assim, o país caminha para um momento decisivo em sua relação com a inteligência artificial e suas várias facetas, incluindo a clonagem.

Confira mais detalhes relacionados ao avanço da IA e seus desafios no mercado brasileiro, como o investimento em IA para cibersegurança e a resistência do público às assistentes virtuais, demonstrando a complexidade do tema em nosso país.