▲

- O uso de vigilância por IA nos Estados Unidos monitorando imigrantes inclui reconhecimento facial e análise comportamental automatizada.

- Você pode ser afetado caso tecnologias similares sejam adotadas no Brasil sem regulamentação adequada para proteger sua privacidade.

- Essa tecnologia pode aumentar o controle sobre a população brasileira, impactando direitos digitais e promovendo riscos de discriminação.

- Debates sobre fiscalização transparente e engajamento social são essenciais para equilibrar segurança e proteção dos direitos.

O uso crescente da vigilância por IA nos Estados Unidos para monitoramento de imigrantes levanta preocupações que extrapolam as fronteiras americanas. Essa tecnologia, que convence pelo alto grau de automação e análise de dados, indica potenciais ameaças para a privacidade dos brasileiros. Conforme os EUA avançam no controle migratório digital, o modelo adotado passa a servir como um alerta para o Brasil sobre como tecnologias invasivas podem ser aplicadas no âmbito público, afetando direitos individuais.

Como funciona a vigilância por IA nos EUA

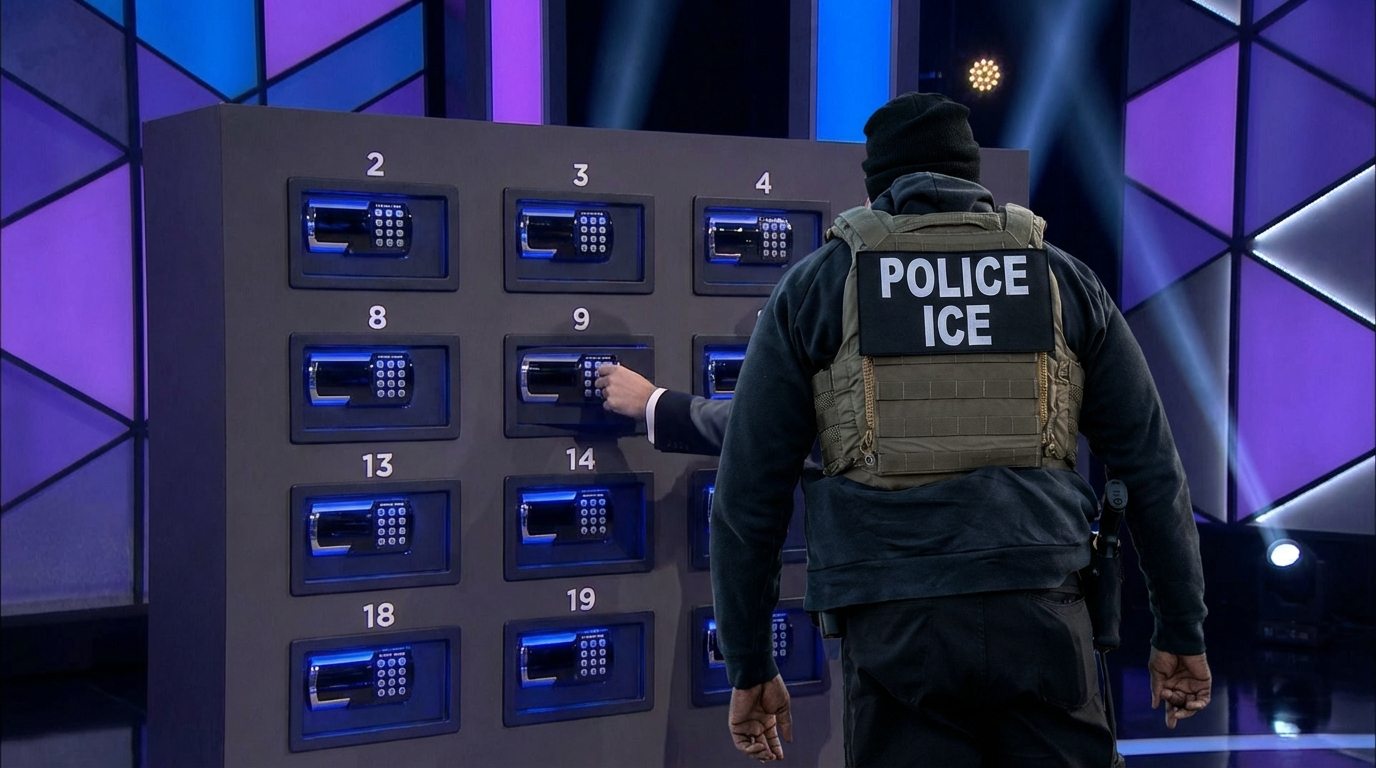

Nos Estados Unidos, órgãos governamentais utilizam algoritmos de inteligência artificial para analisar dados biométricos, históricos e comportamentais de imigrantes. Esses sistemas processam informações para prever riscos de segurança ou irregularidades migratórias sem a necessidade de ação humana constante. A tecnologia inclui reconhecimento facial em câmeras de fiscalização, análise automática de documentos e monitoramento em tempo real de movimentos transfronteiriços.

Esse modelo tem sido reforçado com recursos de machine learning que melhoram a capacidade de antecipação de possíveis infrações migratórias, mas traz à tona questões importantes sobre a transparência dos dados usados e os critérios para a decisão do sistema automatizado.

Além do controle nas fronteiras físicas, a IA é aplicada no monitoramento digital, rastreando a presença online e os contatos sociais dos indivíduos. Estas práticas são justificadas pelo governo americano sob a bandeira da segurança nacional.

A prevalência dessas ferramentas criou um ambiente onde a vigilância constante tende a ocupar um espaço significativo na rotina dos imigrantes, potencialmente violando seu direito à privacidade e liberdade individual.

Perigos para a privacidade brasileira

O modelo de vigilância adotado pelos EUA serve de exemplo para outros países, inclusive o Brasil, onde a implantação de soluções baseadas em IA cresce em ritmo acelerado. Há um risco claro de que práticas semelhantes possam ser integradas a políticas públicas, com pouca regulação e sem garantias robustas de proteção dos dados pessoais.

No Brasil, o debate sobre a proteção da privacidade digital ainda encontra obstáculos, mesmo com legislações como a LGPD, que limitam o uso de dados em algumas circunstâncias. O uso de reconhecimento facial e análise preditiva em áreas sensíveis pode ultrapassar limites éticos e legais se não houver controle social e transparência.

Por isso, especialistas alertam que o país precisa ampliar a regulamentação, principalmente para evitar violações decorrentes do uso indiscriminado da tecnologia em contextos como segurança pública, fiscalização e controle migratório, onde o risco de abuso é maior.

Além disso, a aplicação de sistemas de IA pode exacerbar desigualdades sociais se impactar grupos vulneráveis sem mecanismos adequados de revisão e contestação.

Implicações de vigilância automatizada para cidadãos comuns

A vigilância automatizada por IA, mesmo quando aplicada inicialmente na imigração, pode ampliar seu alcance e afetar diversos setores da sociedade brasileira, incluindo a segurança no trânsito, o monitoramento urbano e o acesso a serviços públicos. Sistemas similares já estão sendo testados para reconhecimento e triagem em ambientes diversos, mas sem clareza suficiente sobre os parâmetros usados.

Esse cenário pode levar ao aumento da vigilância em massa e a um controle mais rígido sobre a população, com risco de erros e preconceitos embutidos nos algoritmos. Casos internacionais mostram que essas tecnologias podem gerar falsos positivos, injustiças e incertezas sobre a real finalidade de seu uso.

O Brasil precisa discutir abertamente os impactos sociais e jurídicos da adoção dessas tecnologias, alinhando a inovação com a proteção dos direitos fundamentais.

Essa discussão é vital para evitar replicar erros observados em modelos estrangeiros, que nem sempre incorporam perspectivas éticas ao desenvolver soluções tecnológicas de segurança.

Como a regulamentação pode proteger os brasileiros

Para minimizar os riscos que a vigilância por IA pode trazer, é fundamental implementar mecanismos regulatórios claros que assegurem a transparência, responsabilização e limitação do uso dessas tecnologias. A combinação entre regulações específicas e a aplicação da Lei Geral de Proteção de Dados (LGPD) deve garantir direitos básicos como o consentimento informado e a contestação de decisões automatizadas.

Outra medida importante é fomentar a auditoria independente dos sistemas de IA usados em ambientes públicos, com acesso público às metodologias e dados utilizados, evitando abusos e viéses discriminatórios.

É também necessária a capacitação de profissionais para compreender e fiscalizar o funcionamento dessas tecnologias, além do engajamento da sociedade civil na formulação e acompanhamento dessas políticas públicas.

Essas ações podem evitar que o Brasil reforce modelos de monitoramento invasivo e garanta um equilíbrio entre segurança e privacidade.

- Controle migratório por IA nos EUA inclui reconhecimento facial e análise de comportamento.

- Riscos à privacidade aumentam com a adoção sem regulamentação adequada.

- População vulnerável corre risco maior de injustiça e discriminação.

- Fiscalização transparente e auditorias são passos essenciais para proteção.

- Engajamento social e legislação eficiente são fundamentais para balancear segurança e direitos.

Esse debate está conectado a outras discussões atuais sobre o uso responsável de IA, como a limitação da mineração de dados e a aplicação da tecnologia na saúde pública IA reality check, proteção em comunicações digitais WhatsApp modo de alta segurança e regulação para evitar vazamentos de dados de grandes empresas vazamentos bilionários.

Com a rápida evolução da IA, o Brasil deve avançar em políticas públicas que se antecipem a ameaças e garantam que as tecnologias servem para melhorar a vida das pessoas sem comprometer sua privacidade e direitos democráticos.