▲

- A DeepSeek apresentou um modelo de IA que prioriza processamento durante a inferência, reduzindo custos e impactando o mercado.

- Você pode se beneficiar de soluções de IA mais eficientes e acessíveis no futuro.

- Isso pode democratizar o acesso à tecnologia de IA, permitindo que empresas menores compitam com gigantes.

- O mercado de hardware e nuvem também deve se adaptar a essa nova tendência.

No início de 2025, a DeepSeek, laboratório chinês de inteligência artificial, apresentou um modelo que movimentou o mercado. O lançamento causou uma queda de 17% nas ações da Nvidia e afetou empresas dependentes da demanda por data centers. O motivo? A DeepSeek conseguiu entregar desempenho alto usando menos orçamento que os concorrentes, apontando um novo caminho para o avanço dos sistemas de IA focado em cálculos no momento da inferência, em vez da dependência de enormes volumes de dados.

Por que o foco está mudando do volume de dados para mais poder no momento da inferência

Os maiores laboratórios de IA já alimentaram seus modelos com quase tudo que existe como dado público acessível na internet. Isso gera uma limitação real para obter avanços apenas aumentando ainda mais o volume de dados brutos. A alternativa mais viável agora parece ser elevar o Compute at Inference, acelerando a capacidade da IA de raciocinar e processar informações dinamicamente na hora da resposta, semelhante ao que modelos da OpenAI vêm fazendo.

A estratégia chamada de test-time compute (TTC) permite que o modelo “pense” mais na hora da inferência, gastando mais recursos calculando suas respostas ao vivo. Pesquisas indicam que o uso intensivo de TTC pode conquistar as mesmas melhorias exponenciais que, até pouco tempo, dependiam só do treinamento prévio com dados gigantescos. Isso abre novas portas para avanços baseados em computação dinâmica durante o uso.

Além disso, a DeepSeek mostrou que laboratórios com menos recursos conseguem criar modelos competitivos por meio desse foco na inferência otimizada. Isso questiona a vantagem dos laboratórios que investem cifras bilionárias só para ampliar o repositório de dados e os clusters de treinamento, transformando a infraestrutura necessária para produzir IA de alto desempenho.

Assim, a indústria observa uma transição sutil: em vez de escalar para conjuntos de dados cada vez maiores, o foco técnico passa a ser ampliar o raciocínio ativo realizado durante o uso, o que pode renovar todo o ecossistema das aplicações empresariais, fundações de modelos, chips e nuvem.

Leia também:

Como o cenário tecnológico deve mudar a partir da ênfase em inferência dinâmica

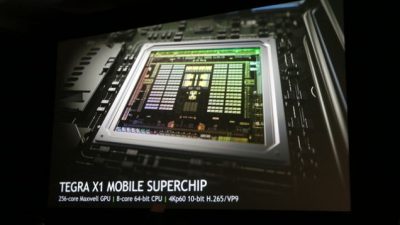

Com mais recursos concentrados na hora do uso do modelo, as prioridades nas arquiteturas de hardware também devem se transformar. Antes, a tendência era criar clusters maciços, parrudos para treinamento em larga escala. Agora, os investimentos podem migrar para impulsionar a capacidade de inferência, com sistemas capazes de lidar com picos de demanda por raciocínio complexo online.

Isso gera oportunidades para hardware especializado, como os circuitos integrados específicos para aplicações, ou ASICs, voltados para inferência rápida e eficiente. Enquanto GPUs tradicionais seguem importantes, sua liderança pode diminuir frente a chips otimizados para a nova fase da IA baseada em TTC, com menor latência e ajuste fino para raciocínio instantâneo.

O cenário de nuvem também pode mudar. Provedores como Azure, Google Cloud e AWS podem se destacar se entregarem qualidade de serviço garantida nas APIs de inferência. Isso porque o uso maior de TTC tende a tornar a performance das respostas mais volátil, com oscilações, dificuldades para gerenciar muitas requisições simultâneas e limites variados entre diferentes serviços.

Curiosamente, mesmo simplificando e economizando em etapas de treinamento, o aumento da eficiência em inferência pode elevar o consumo total de recursos. Isso porque, segundo o paradoxo de Jevons, ganhos em eficiência acabam estimulando novas aplicações e, consequentemente, mais demanda por processamento na nuvem.

Desdobramentos competitivos para modelos fundacionais e uso corporativo

Um efeito relevante é a possibilidade de players menores entrarem na disputa por modelos de base que rivalizem com as grandes companhias, como a OpenAI, Anthropic, Cohere, Mistral ou a própria DeepSeek. Se entregar qualidade passar menos pela quantidade de dados no treinamento e mais pela inferência inteligente, as barreiras para novos entrantes podem diminuir, estimulando inovação e diversidade de fornecimento.

Ao mesmo tempo, o mercado corporativo mostra cautela para adotar produtos desenvolvidos por firmas como a DeepSeek devido a preocupações com segurança e privacidade, ainda mais considerando sua origem chinesa. Muitos relatos apontam que empresas no Ocidente bloqueiam o uso ou limitam o acesso às APIs, e isso tende a continuar até novas garantias ou regulações surgirem.

Os riscos discutidos incluem possíveis vulnerabilidades a ataques, geração de conteúdos tendenciosos ou prejudiciais, facilidade em contornar limites de segurança e desafios para garantir conformidade com regras locais. Isso dificulta a adoção direta, mas pode incentivar outras empresas a aprenderem com as soluções técnicas propostas pela DeepSeek para melhorarem seus próprios modelos.

Novas oportunidades para software sobreposto e aplicações verticais

Com o avanço estagnando no aumento de dados para o pré-treinamento, abrem-se oportunidades no desenvolvimento de camadas de software especializadas. Técnicas como geração otimizada de prompts, ajuste fino de amostragem ou estratégias conscientes da latência podem melhorar o desempenho da IA em casos de uso específicos.

Essas otimizações são especialmente atraentes para setores que dependem de respostas rápidas e precisas, como atendimento automatizado, aplicativos financeiros ou sistemas médicos com interação em tempo real. Nesse aspecto, startups e empresas com conhecimento em nichos podem se diferenciar sem depender tanto dos gigantes da IA.

Esse movimento também reduz o risco de os avanços nos modelos básicos tornarem obsoletos os aplicativos de terceiros, o que era uma preocupação constante até pouco tempo. Agora, com foco no raciocínio durante o uso, há espaço para melhorar a performance vertical de forma incremental, preservando o valor de soluções específicas.

O efeito geral do fenômeno DeepSeek, somado a essa tendência, aponta menos relevância para quem detém montanhas de dados e mais para quem consegue pensar rápido. Isso reforça um cenário onde inovação em torno do aperfeiçoamento da inferência ganha protagonismo nas aplicações práticas.

O novo ciclo de investimentos, hardware e pesquisa no ambiente IA

Os avanços recentes induzem empresas a recalibrar suas estruturas de gastos. Em vez de priorizar infraestruturas enormes só para treinamento, a tendência será direcionar recursos para processamento ágil e ajustável voltado ao uso final. Isso gera, inclusive, complexidades novas para gestão da capacidade, já que a demanda na inferência pode ser volátil e imprevisível.

Com picos momentâneos mais difíceis de prever, o planejamento da infraestrutura passa a considerar não só o volume, mas também a variabilidade do consumo. Além disso, o foco em otimizar trajetória do raciocínio dinâmico pode impulsionar a criação de algoritmos que equilibram qualidade da resposta, custo computacional, tempo de espera e especificidade das tarefas.

Essas mudanças tendem a gerar uma competição maior entre os provedores de nuvem, que precisarão oferecer serviços mais estáveis e eficientes para inferência baseada em TTC. Para as fabricantes de chips, criar soluções dedicadas para otimizar processamento nesse momento ganha relevância, estimulando um ciclo diferente de inovação em hardware.

Empresas que dependem do crescimento contínuo da demanda por data centers para IA, como a Nvidia, enfrentam um cenário menos previsível. Avanços como os da DeepSeek indicam que nem sempre será preciso investir cada vez mais em infraestrutura gigante, mudando o perfil dos investimentos nos próximos anos.

Enquanto as regulações ganham força no setor, há também discussões recentes sobre a necessidade de antecipar normas para IA em mercados como o brasileiro. Por exemplo, a Anatel já avalia antecipar diretrizes para IA no setor de telecomunicações, impactando como empresas locais integram essas tecnologias.

Esse ambiente fértil para mudanças sugere que, embora o volume de dados continue relevante, o verdadeiro diferencial competitivo deve migrar para a capacidade dos modelos pensarem mais rápido e melhor durante o uso, com ganhos concretos nas mais diversas aplicações.

Este conteúdo foi auxiliado por Inteligência Artificial, mas escrito e revisado por um humano.