▲

- O Brasil ainda não possui regulamentação específica para o uso de inteligência artificial em imagens pessoais.

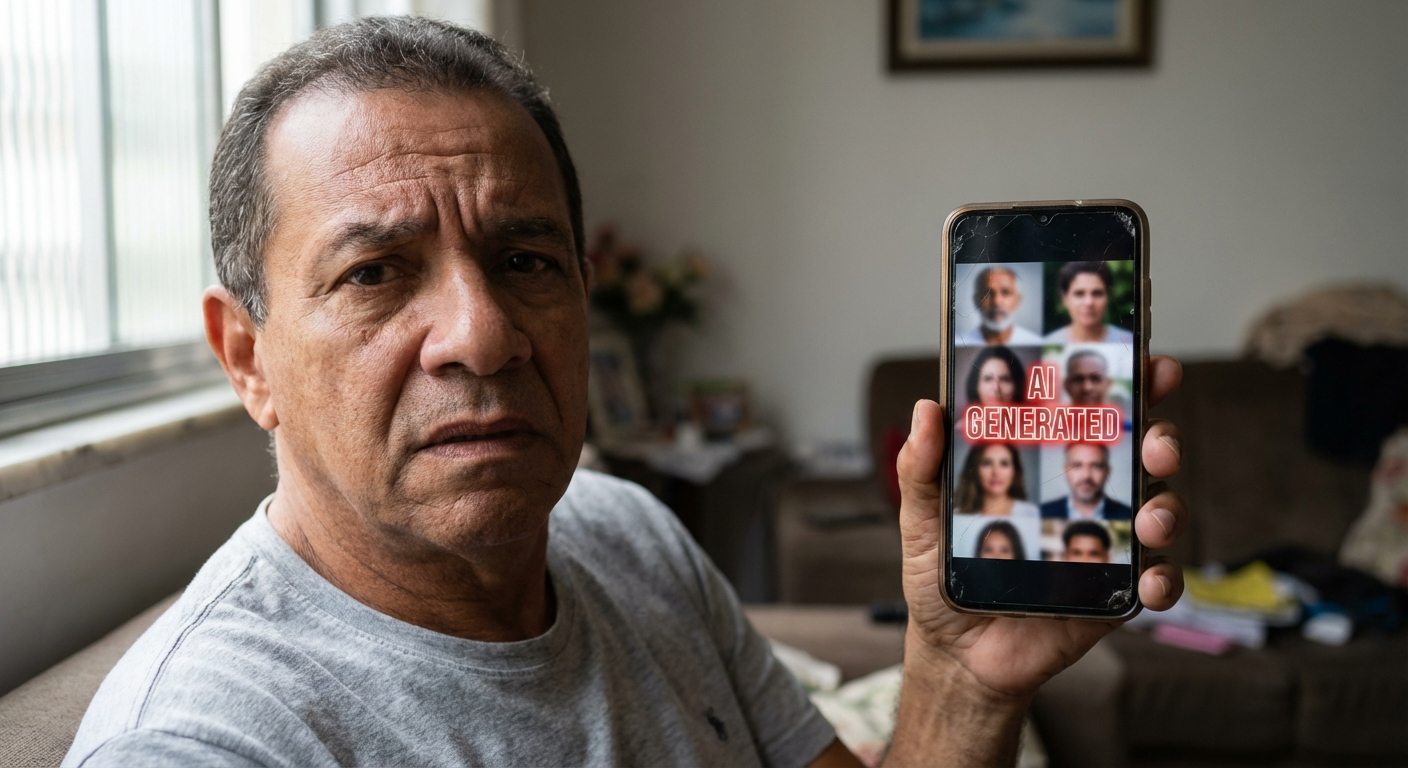

- Você pode estar vulnerável a manipulações, fraudes e invasões de privacidade causadas pelo uso indevido da IA em suas imagens.

- A falta de leis claras dificulta a punição de crimes digitais e aumenta os riscos de golpes e desinformação na sociedade.

- A discussão pública e avanços legislativos são essenciais para garantir segurança, transparência e responsabilidade no uso de IA.

Apesar do avanço acelerado da inteligência artificial (IA) em diversas áreas, o Brasil ainda não possui uma regulamentação específica para o uso de IA em imagens pessoais. Esse vazio legal gera preocupações sobre a privacidade e a segurança dos cidadãos, expondo-os a riscos inéditos relacionados à manipulação, uso indevido e até clonagem digital de suas imagens.

O desafio da ausência de regulamentação no Brasil

Enquanto países ao redor do mundo avançam para criar leis que regulem o uso de IA em dados pessoais, inclusive imagens, o Brasil permanece em uma zona cinzenta, sem normas específicas que abranjam esse campo. A Lei Geral de Proteção de Dados (LGPD) estabelece regras gerais para dados pessoais, mas não responde de forma detalhada às nuances da inteligência artificial e suas capacidades atuais.

O uso crescente de tecnologias como deepfake, reconhecimento facial e geração de imagens sintéticas amplia o leque de riscos para a população. Sem regulamentação clara, qualquer pessoa pode ter sua imagem manipulada sem consentimento, potencialmente usada para fins ilegais ou antiéticos, como fraudes, difamações ou golpes. Especialistas alertam que essa situação pode se agravar, criando um ambiente propício para abusos.

Além disso, a falta de uma legislação específica dificulta a atuação do sistema judiciário e das autoridades na prevenção e punição dos crimes relacionados à IA em imagens pessoais. Nesse contexto, surge uma demanda urgente pela definição de direitos e responsabilidades para desenvolvedores, empresas e usuários.

Quais são os principais riscos para os brasileiros?

A ausência de regras claras traz riscos concretos, que já começam a se manifestar no cotidiano. Entre eles:

- Manipulação de imagens e vídeos: o uso de deepfakes para criar conteúdos falsos pode prejudicar a reputação de indivíduos e empresas.

- Golpes e fraudes digitais: imagens pessoais manipuladas podem ser usadas para golpes, como no caso da clonagem de identidade digital.

- Invasão de privacidade: o tratamento indevido de imagens pode expor dados sensíveis sem controle do titular.

- Desinformação: a propagação de conteúdos falsos gerados por IA, especialmente em contextos eleitorais, afeta a confiança pública.

Esses exemplos ilustram por que a legislação precisa acompanhar o avanço tecnológico para proteger os direitos dos cidadãos, minimizando os efeitos nocivos da IA mal utilizada.

Quais iniciativas globais servem de referência?

Na União Europeia, o Regulamento Geral de Proteção de Dados (GDPR) já incorpora princípios que incluem o uso ético da IA, exigindo transparência e responsabilização. Países como os Estados Unidos e o Canadá discutem leis específicas para inteligência artificial, buscando equilibrar inovação com segurança dos dados pessoais.

Além disso, organismos internacionais têm debatido diretrizes éticas para o desenvolvimento e uso responsável da IA, envolvendo princípios como justiça, privacidade e responsabilidade. Essas referências podem servir de base para o Brasil definir seus próprios marcos regulatórios.

Importância da discussão pública e do avanço legislativo

Para que o Brasil consiga acompanhar o ritmo das transformações digitais, a regulamentação precisa ser objeto de um debate amplo, envolvendo governo, especialistas, empresas e sociedade civil. Essa participação inclusiva pode garantir que a nova legislação seja eficaz e equilibrada.

Enquanto isso, instituições acadêmicas e organizações da sociedade já estudam iniciativas para monitorar e analisar o uso da IA em imagens, buscando alertar para os desafios atuais. Reconhecer a urgência do tema é o primeiro passo para evitar que o país fique atrás em proteção digital.

Vale destacar que a preocupação ultrapassa o campo tecnológico e alcança a segurança pública, direito à privacidade e integridade moral das pessoas.

Panorama tecnológico e situações recentes no Brasil

No Brasil, casos de golpes eletrônicos envolvendo inteligência artificial já foram detectados, como fraudes em cartórios e clonagem de identidade digital. Esses episódios mostram que a ausência de regulamentação específica contribui para uma vulnerabilidade crescente da população frente a práticas ilegais facilitadas por IA.

Além disso, o cenário brasileiro tem desafios únicos, como a necessidade de especialização técnica e adaptação de serviços públicos e privados para lidar com as novas ameaças.

Empresas brasileiras e startups têm investido em soluções que usam IA para segurança da informação, mas sem uma base legal sólida, o ambiente fica instável para desenvolver tecnologias que possam proteger as imagens pessoais dos usuários.

O que está pendente para a regulação no Brasil?

Alguns projetos de lei tramitaram no Congresso Nacional buscando regular o uso da inteligência artificial, mas ainda não avançaram para contemplar especificamente a proteção das imagens pessoais. A definição de parâmetros éticos e legais para a criação, utilização e compartilhamento dessas imagens é um ponto crucial a ser debatido.

Além disso, um desafio relevante é fazer com que a legislação acompanhe a velocidade das inovações tecnológicas, sem prejudicar o desenvolvimento do setor, mantendo o equilíbrio necessário entre inovação e proteção ao cidadão.

O fortalecimento da fiscalização e a criação de órgãos especializados também são aspectos que podem colaborar para a efetividade do futuro marco regulatório.

Resumo dos principais pontos que precisam ser abordados na regulação

- Definição clara do que configura uso legítimo e uso abusivo de IA em imagens pessoais.

- Proteção contra manipulação não autorizada, como deepfakes e clonagens digitais.

- Regras para responsabilização de desenvolvedores e empresas que operam com IA.

- Mecanismos de transparência para que indivíduos possam controlar o uso de suas imagens.

- Medidas de combate a fraudes e desinformação envolvendo imagens geradas ou modificadas por IA.

Como a regulamentação pode beneficiar a sociedade e a economia

Uma legislação bem estruturada pode fomentar a confiança dos usuários em tecnologias baseadas em IA, criando um ambiente seguro para o desenvolvimento de novos produtos e serviços.

Além disso, a proteção reforçada ajuda a mitigar riscos que possam gerar prejuízos financeiros e morais aos cidadãos, o que impacta positivamente o clima de negócios e a inovação.

Com normas claras, o Brasil também pode atrair investimentos estrangeiros em tecnologia, mostrando compromisso com governança e compliance digital.

Por fim, a regulamentação contribui para a construção de um ecossistema ético na IA, que respeite os direitos humanos e fortaleça o estado democrático de direito.

Esse cenário se conecta à discussão mais ampla sobre os riscos éticos e sociais da IA no Brasil, tema que tem ganhado espaço em debates acadêmicos e legislativos conforme detalhado em reportagem sobre por que a legislação brasileira de IA ainda falha em proteger direitos humanos e sociais.

Enquanto essa regulação não se consolida, cabe a cada usuário estar atento às políticas de privacidade e uso das plataformas digitais, além de conhecer os direitos assegurados pela LGPD.

O uso ético da tecnologia em imagens pessoais é um dos grandes desafios da revolução digital no país, refletindo diretamente em direitos civis fundamentais, segurança digital e a confiança da população nas novas tecnologias.